История и развитие лицевой анимации в видеоиграх

Главной темой марта стала лицевая анимация, за что стоит поблагодарить «просто работников» Bioware. Mass Effect: Andromeda — наглядный пример того, когда технические ошибки в одном компоненте игры тащат за собой на дно Metacritic'а всю конструкцию. И эта ситуация — яркое напоминание о том, что за несколько десятков лет анимация серьезно эволюционировала. Там, где раньше обходились парой разноцветных пикселей, теперь не спасают и тысячи полигонов.

Вчера

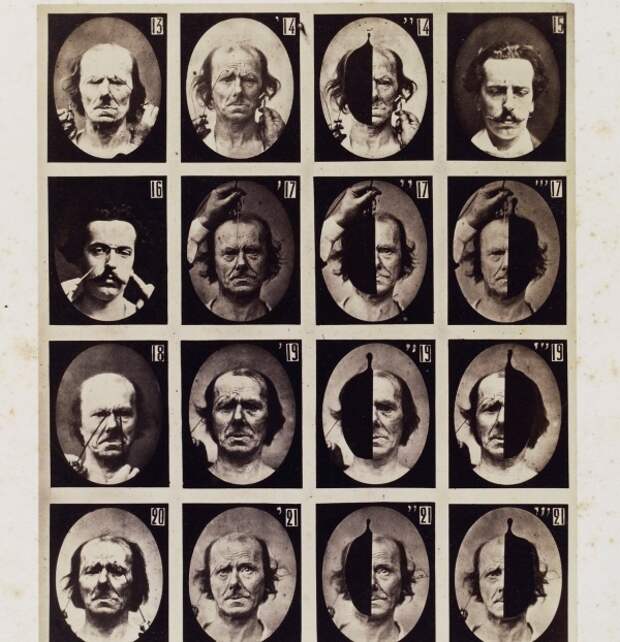

Чарльз Дарвин — «Выражение эмоций у человека и животных» (1872 год)

Чарльз Дарвин — «Выражение эмоций у человека и животных» (1872 год) Попытки перенести человеческую мимику на экран монитора начались в 70-х годах прошлого века. В 1974 году инженеры Фред Парк и Эд Катмулл впервые продемонстрировали свои наработки — объемную лицевую модель, выполняющую ряд движений. Спонсировала исследования компания DARPA — один из лидеров в области робототехники на данный момент. Работа инженеров из Университета Юты вызвала восторг в научной среде, но особенно обрадовались этому открытию прозорливые голливудские продюсеры, желавшие применить новую технологию в кинопроизводстве.

Важным открытием в понимании лицевой механики стала система FACS (Facial Action Coding System), разработанная Карлом Хертсьо в конце 60-х и улучшенная Экманом и Фризеном в 1978-ом. Эта математическая модель состояла из 46 элементов, которые описывали основные движения мускулов лица — положение бровей, подмигивание, движения губ — и «привязывали» их к определенным эмоциям. После этого мордашка на экране могла злиться, удивляться, радоваться и скорбеть о своей незавидной участи.

Важной вехой в истории компьютерной анимации стала короткометражка 1985 года «Tony de Peltrie», в которой история раскрывалась с помощью мимики персонажа. Модель, представленная в фильме, впервые действовала согласно физическим законам движения лицевых мышц. Десятилетие спустя очередными знаковыми вершинами в развитии визуальных эффектов станут фильмы «Каспер» и «История игрушек», где главные роли будут отданы полностью трехмерным моделям. Затем в Голливуд придут нулевые и технология захвата движений motion capture станет незаменимой при создании блокбастеров. Наступит эпоха талантливого британского актера Энди Серкиса, сыгравшего Голлума, Кинг-Конга, Сноука из последних номерных «Звездных войн».

Энди Серкис смотрит на тебя, как на камеру motion capture

Энди Серкис смотрит на тебя, как на камеру motion capture В игровой индустрии конца 80-х и периода NES никто особо и не задумывался о лицах персонажей — пара пикселей вместо лица, и то хорошо! Воображение помогало слабому «железу» заполнять некоторые пробелы в восприятии. Да, фантазия тогда играла несравненно бОльшую роль, чем сейчас. Неудивительно, что приметив моргающих персонажей в Secret of Mana или The Legend of Zelda: Ocarina of Time, многие игроки удивлялись не на шутку.

Момент, когда понял, что ты играешь в Зельду, но до Switch еще пара десятков лет

Момент, когда понял, что ты играешь в Зельду, но до Switch еще пара десятков лет Remedy при создании первого Max Payne пошли своим путем при создании анимации и окружения. Отказавшись от дорогостоящих кат-сцен в пользу стильных комикс-вставок, ушлые финские разработчики фотографировали реально существующие места, а после накладывали фильтры и добавляли получившиеся фототекстуры в игру. Так же поступили и с лицами персонажей, уговорив Сэма Лэйка, сценариста и дизайнера, пожертвовать свою физиономию главному герою. Такой метод принес свои плоды. На тот момент, графика Max Payne считалась чуть ли не фотореалистичной, даже рожи бандитов были разными! На рубеже тысячелетий о таком можно было только мечтать...

В большинстве игр, как правило, анимация создавалась по аналогии с тем, как это происходило в классической мультипликации: художник выставлял положение персонажа лишь в ключевых кадрах, а все промежуточные просчитывались автоматически.

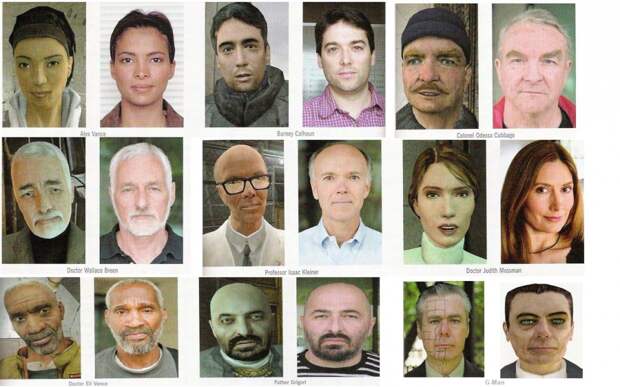

Valve Software также пользовались подобной техникой. Сюжет строился на изучении окружения и взаимодействии между персонажами, поэтому лицевая магия была крайне важна. Истории Black Mesa, а позже и City 17 казались цельными, не в последнюю очередь, благодаря анимации, передающей чувства и страхи героев.

В Half-life 2 разные лица смогли пригодиться

В Half-life 2 разные лица смогли пригодиться Сегодня

Совсем иной подход к созданию игр предлагал Дэвид Кейдж и его парижская студия Quantic Dream. Кейджа можно считать одним из апологетов motion capture в игровой индустрии. Конечно, подобная технология использовалась и до него. В том же Mortal Kombat вся анимация была записана подобным способом, но именно для француза эта технология стала образующей — Fahrenheit, Heavy Rain, Beyond и грядущий Detroit невозможно представить без mo-cap'а, нарисованными классическим способом.

Плюсы motion capture очевидны:

- датчики передают такие микродвижения, которые даже опытный аниматор не всегда в состоянии вычленить из общей гаммы эмоций;

- mocap отлично просчитывает такие характеристики как масса и инерция, потому что все действия выполняют реальные актеры, каждый со своей физикой;

- технология позволяет фиксировать множество вариантов одной анимации, каждый из которых будет уникальным;

- работа с mocap'ом экономит время, позволяя не рисовать каждое движение вручную с нуля.

Но и минусов тоже хватает:

- технология очень дорогостоящая. Да, студия экономит на работе аниматоров, но в то же время тратит немалые суммы на новых специалистов, включая хороших актеров. Затраты окупаются только при работе над крупными проектами с серьезным финансированием, для которых необходимо много анимаций. Зачастую, разработчики снимают mocap-студии — это гораздо дешевле, чем держать свою. Стоимость оборудования достигает орбиты Сатурна (некоторые производители вообще не указывают цену, предоставляя информацию «по запросу»);

- в любом случае каждая mo-cap-сцена требует шлифовки, так что аниматоры без дела сидеть не будут;

- данные захвата движения сложнее изменять, чем ручную анимацию;

- некоторые движения практически невозможно получить через mo-cap, другие же приходится долго подгонять под технические требования (анимационный цикл, кадрирование, движения по определенным осям).

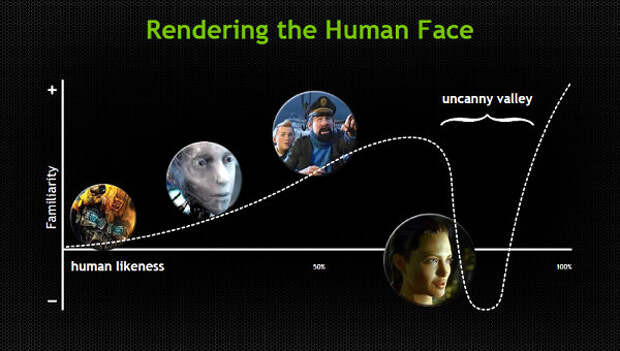

Дэвиду «хочу больше эмоций» Кейджу нелегко живется в современных игровых реалиях. Являясь евангелистом «игр как кино» он идет своей дорогой и в данном случае, технология motion capture помогает творить его личные истории. Может быть на следующем витке технологий он достигнет желаемого результата, не угодив при этом в ловушку под названием «зловещая долина».

Феномен «зловещей долины» описан во множестве книг и статей

Феномен «зловещей долины» описан во множестве книг и статей Но не одним motion capture едины. Наверное, так и думала австралийская студия Team Bondi во время создания L.A. Noire — детектива с лучшей лицевой анимацией за всю историю игр. Noire стал первым проектом, использовавшим программно-аппаратную технологию MotionScan, предназначенную для оптического сканирования лица человека и перевода отсканированных данных в цифровой формат. MotionScan был создан земляками Team Bondi — австралийской компанией Depth Analysis.

32 HD-камеры снимали лицо человека с 32-х ракурсов. Затем видеофайлы преобразовывались в единое трехмерное изображение. Удобство заключалось в том, что для сканирования мимики на актера не нужно было надевать никаких датчиков или наносить какие-либо краски. Согласно Team Bondi, при создании анимации они использовали устройство захвата MotionScan с суммарным объемом памяти в 200 ТБ.

Лицевая анимация — главная фишка L.A. Noire. Игроку в роли детектива приходилось «раскалывать» подозреваемых во время допросов, определять по мимике врут они или нет. Поэтому поиски технологии захвата движения были столь важны. Без motion capture не было бы той Quantic Dream, что мы знаем, а без MotionScan — L.A. Noire.

К сожалению, технология оказалась более живучей, чем Team Bondi, которая обанкротилась вскоре после выхода игры. Но при всей своей реалистичности было у MotionScan и несколько минусов. Главный недостаток заключался в том, что лица жили своей жизнью — детализированные, они контрастировали с остальной игровой графикой. Возникал странный эффект оторванности головы от остального тела, больше похожего на манекен.

Вдобавок, записанные анимации было сложно редактировать и, если обнаруживался какой-либо дизайнерский просчет, приходилось искать ключи от студии и заново снимать материал.

Джейсон Митчелл, специалист по 3D-графике из Valve, так прокомментировал лицевую анимацию в L.A. Noire: «Мы хотим, чтобы персонажи реалистично реагировали на то, что делает игрок, а не действовали так, как было записано на mocap сессиях. Поэтому мы пока не знаем, можно ли использовать MotionScan в наших проектах».

Noire так и остался единственной игрой, использующей MotionScan, который затем благополучно перекочевал в кинематограф. Тем не менее эксперимент оказался удачным — детективный жанр пополнился достойным представителем, а многие игроки получили уникальный опыт.

Завтра

Процесс создания лицевой анимации в последние годы заметно упростился. Набирает популярность софт для анимирования в реальном времени, использующий такие датчики как обычные веб-камеры, Kinect или другие устройства на основе структурированного света. Даже простого смартфона хватит для того, чтобы игрок отсканировал свое лицо и создал аватара «по образу и подобию».

Сканирование лица в NBA 2k17 дало неожиданный результат. Моей вины здесь нет

Сканирование лица в NBA 2k17 дало неожиданный результат. Моей вины здесь нет Сервисы Faceware или Mixamo могут достигать высокой детализации в режиме реального времени без использования каких-либо маркеров. Алгоритм Faceshift, работающий в связке с Kinect, основан на автономном этапе отслеживания мимики, который обучает систему различным выражениям лица. Согласованные последовательности используются для построения модели для конкретного человека, которая впоследствии используется для онлайн-отслеживания лица и передачи выражений.

Какой простор открывается для видеоблогеров, пранкеров и любителей конспирологических теорий, когда любое видео можно подделать в режиме online.

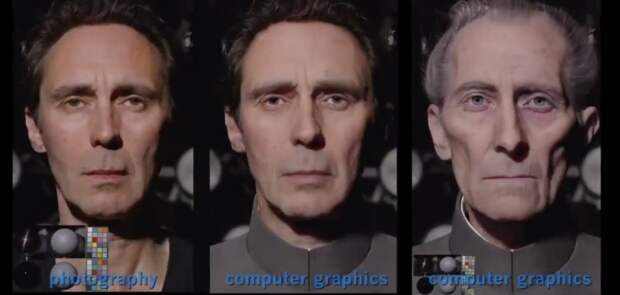

Не отстает и Голливуд, в очередной раз используя достижения лицевой анимации в своих целях. В этот раз для воскрешения умерших актеров. Но, как известно, герои поп-культуры не умирают навсегда, поэтому мы видим «ожившего» Питера Кушинга и молодую Кэрри Фишер в новых «Звездных войнах».

Метаморфозы «Звездных войн»

Метаморфозы «Звездных войн» В будущем стоит ждать реанимированных с помощью CGI юного Марлона Брандо, Мэрлин Монро и Кларка Гейбла, а там и Кобейн с Хендриксом подтянутся. Интересно, а кому принадлежат права на использования лиц знаменитостей?

Учась рисовать, ребенок с детства понимает нюансы мимики и отражает это, как может, на своих рисунках. Наши лица очень информативны. Они служат нам своеобразными точками доступа при общении друг с другом. Сочувствие, злость, страх, одобрение — компьютерная лицевая анимация, возникшая полвека назад, продолжает развиваться. Главное во всем этом прогрессе — использовать технологии правильно и не терять уже своего лица.

Свежие комментарии